DeepSeek-OCR 私有版本部署

特别说明

本章节内容为可选阅读,仅供参考。由于不同的硬件配置与部署环境可能存在差异,实际问题也会有所不同。建议按照本文环境及操作步骤执行,如遇异常可随时向 AI 寻求帮助,或咨询 vLLM 官方,PIG AI 无法提供支持。

一、环境准备

1.1 硬件与系统要求

请确保你的设备满足以下最低配置:

- GPU:NVIDIA GeForce RTX 4090(显存 ≥24GB)

- 操作系统:Ubuntu 22.04 LTS(推荐使用纯净安装)

- CUDA 版本:12.8

- Python 版本:3.11

验证 CUDA 安装

如果你不确定 CUDA 是否已正确安装,可运行 nvcc --version 查看版本。

1.2 创建 Python 虚拟环境并安装依赖

打开终端,依次执行以下命令:

配置建议

建议将 export HF_ENDPOINT=https://hf-mirror.com 添加到 ~/.bashrc 文件中,避免每次重启终端后重新设置。

二、启动 DeepSeek-OCR 服务

在激活的 vllm-fix 环境中,运行以下命令启动模型服务:

模型下载说明

此命令会自动从 HF-Mirror 下载模型(首次运行较慢,请耐心等待)。

服务默认监听 http://localhost:8000,可通过 --port 参数修改端口。

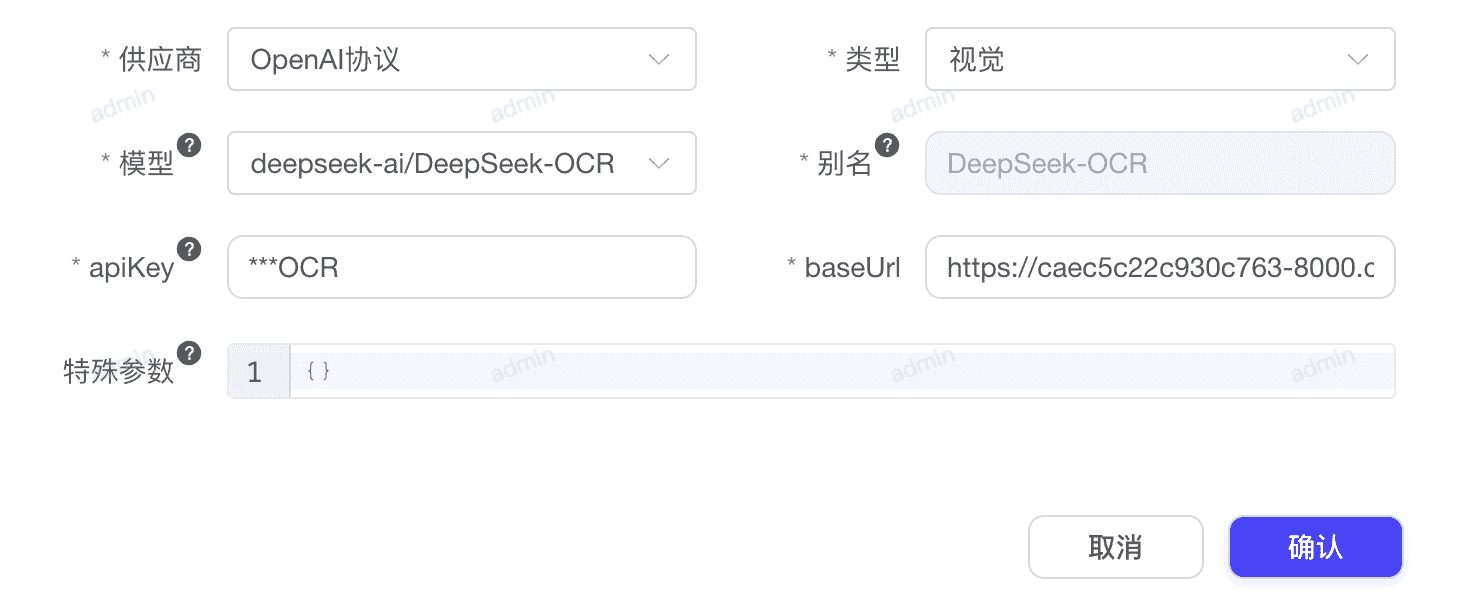

三、在 PIG AI 系统中接入模型

- 登录 PIG AI 后台管理系统。

- 进入「模型管理」页面。

- 添加新模型,填写以下信息:

- 模型名称:

deepseek-ai/DeepSeek-OCR - 模型类型:OCR 多模态模型

- 服务地址:填写上一步中 vLLM 服务的 URL(如

http://localhost:8000/v1)

- 模型名称:

四、测试识别效果

- 打开 PIG AI 的 AI 慧眼 功能。

- 上传一张包含文字的图片(如发票、表格、截图等)。

- 务必开启“高级解析模式”。

输出格式限制

DeepSeek-OCR 本身 不输出结构化 JSON,仅提供原始文本识别结果。 若需结构化输出(如字段提取、表格解析),需配合其他模型或后处理模块使用。

本页目录